A mesterséges intelligencia (AI) az elmúlt években egyre ismertebbé vált a civil szférában is, azonban a népszerűségének drasztikus növekedését a generatív nyelvi modellek idézték elő. Az AI ezen típusa azonban nem csak mindennapi szövegek generálására használható, de könnyen trollfarmok, valamint dezinformációs kampányok eszközeivé is válhat. A hasonló technológiák veszélyeiről, valamint a védekezés lehetőségeiről a Josh A. Goldstein (CyberAI Projekt, Georgetown University) és Girish Sastry (Policy Team, OpenAI) alkotta szerzőpáros értekezett a Foreign Affairs hasábjain.

A mesterséges intelligencia jelensége korábban is komoly aggodalmakat váltott ki a nemzetbiztonsággal foglalkozó kutatói közösségből, azonban eddig nem jelentett akut, széleskörű fenyegetést. Ezzel szemben, a generatív nyelvi modellek megjelenése és azok egyik napról a másikra létrejövő népszerűsége következtében újra kell értékelnünk az általuk okozott kockázatokat.

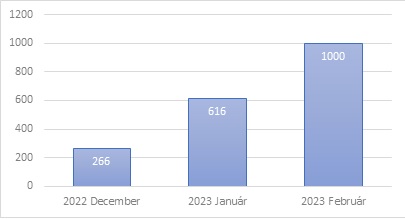

A nyelvi modellek több szempontból is fenyegethetik a társadalmat, azonban az egyik legfontosabb probléma a dezinformációs kampányokban való felhasználhatóságuk. Ez a kockázat pedig egyre inkább növekedhet, párhuzamosan az eszközök népszerűségével. A ChatGPT például a 2022 decemberi indulása óta egymilliárdra növelte az oldal havi kattintásszámát.

A ChatGPT havi kattintásszáma (millió)

Forrás: similarweb.com

A ChatGPT-hez hasonló nyelvi modellek a mesterséges intelligencia büntető-jutalmazó fejlesztésén alapszanak: a program egy hosszú szöveges forrás következő szavát próbálja megjósolni, a sikeresség függvényében pedig moderálja saját magát. Bár a ma használt programok rendelkeznek korlátokkal, mégis képesek összefüggő szövegek gyártására – kisebb hibákkal.

Azonban ahogy ezek az eszközök egyre fejlettebbé válnak, egyre népszerűbbek lesznek a propagandaipar szereplői között.

A szerzőpáros rámutat, hogy a különböző trollfarmok a mesterséges intelligencia számos előnyét ki tudják használni. Az egyik legfontosabb, hogy a hasonló programokkal olcsón és gyorsan lehet gyártani emberi eredetűnek tűnő szövegeket. Ez nagyban felgyorsítja a propagandatermék létrehozásának folyamatát, így növelheti annak mennyiségét. Ennek következtében a rossz szándékú trollhálózatok könnyen eláraszthatják a célpont információs terét, ezzel túlterhelve mind a rendszert, mind a felhasználókat.

Ezen felül érdemes megemlíteni, hogy az AI nem csak mennyiségbeli, hanem minőségbeli különbséget is jelenthet ezen hálózatok számára.

Például egy – a szerzők által hivatkozott – kutatás kimutatta, hogy a nyelvi modellek képesek lehetnek bizonyos társadalmi csoportok szociokulturális sajátosságainak kiismerésére, és ennek függvényében tudják torzítani a generált szöveget.

Ez nagyban megkönnyítheti a dezinformációs kampányok személyre szabását, tekintve, hogy például a Jevgenyij Prigozsin orosz oligarchához köthető Internet Research Agency a 2016-os amerikai elnökválasztásai kampányba való beavatkozásakor igyekezett beépülni különböző társadalmi közösségekbe.

Goldstein és Sastry továbbá kiemeli, hogy nem is kell feltétlenül AI-támogatott dezinformációs műveletnek történnie ahhoz, hogy a technológia jelenléte növelje a társadalom kitettségét. A mesterséges intelligencia veszélyei okozta bizalmatlanság könnyen táptalaja lehet egy esetleges kampánynak:

ezek a műveletek sokszor nem meggyőzni kívánják a felhasználókat, csupán elárasztani az információs teret, hogy az áldozatoknak ne érje meg az igazság feltárása által igényelt erőfeszítés.

Ezt például jól mutatja az orosz propagandagépezet attitűdje a maláj gép tragédiája után.

Bár a mesterséges intelligencia által működtetett nyelvi modellek a propaganda hatékony eszközei lehetnek, a szerzők szerint az AI-támogatott kampányok kivitelezésének három előfeltétele van. Az első, hogy az azt végző szervezetnek hozzá kell férnie egy megfelelően fejlesztett modellhez. Ezen a szinten az államok, vagy akár a fejlesztők, nagyban megnehezíthetik a technológiához való hozzájutást, de akár a propagandagyanús szövegek létrehozását is korlátozhatják. Másodszor a propaganda terjesztéséhez szükség van egy közösségi média profilokból vagy éppen honlapokból álló hálózatra. Ez esetben a közösségi média platformok proaktív intézkedései lehetetleníthetik el a hasonló szándékokat, például a szövegek eredetének feltüntetésével. Végül pedig a rossz szándékú szervezeteknek szükségük van kitett, instabil társadalmi csoportokra, amelyekben terjedhet a létrehozott dezinformáció. Ez azonban a reziliencia elősegítésével, valamint a széleskörű edukációval megakadályozható.

Összefoglalva tehát a mesterséges intelligencia - különösen a nyelvi modellek - új kihívás elé állítják a dezinformációs kampányok ellen védekező államokat, azonban ezek átfogó intézkedésekkel megelőzhetők.

Szemlézte: Szenes Eszter

Tetszett a cikk? Hasonló tartalmakért kövess minket a Facebookon